Nová hrozba zvaná „Skill Squatting“ objevená UIUC

1 minuta čtení

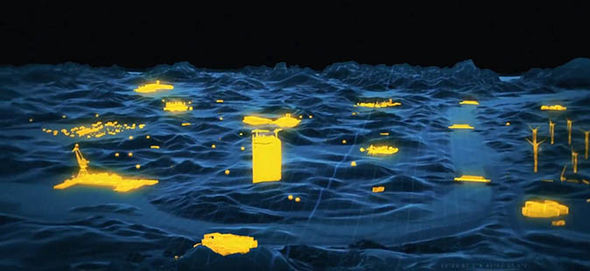

Amazon Echo

Svět se mění a v moderní době se ze dne na den spoléháme na naše zařízení internetu věcí. Ale tato důvěra nás mohla stát všechno, mohla by někomu umožnit ukrást naši identitu, bankovní informace, anamnézu a co ne.

Amazon Alexa byl kritizován za řadu bezpečnostních nedostatků, ale Amazon si s nimi rychle poradil. Tato nová chyba zabezpečení však nemusí mít opravu vůbec. A to by mohla být dosud nejnebezpečnější bezpečnostní hrozba.

Podle výzkumu provedené University of Illinois v Urbana-Champaign (UIUC), idiosynkrázy Amazonu Alexa lze využít pomocí hlasových příkazů k přesměrování uživatelů na škodlivé weby. Hackeři se zaměřují na mezery v algoritmech strojového učení pro přístup k soukromým informacím.

Metodu nazvanou „Skill squatting“ vytvořili vědci z University of Illinois v Urbana-Champaign a je úspěšnou metodou, jak přimět Amazon Alexa k přesměrování uživatelů na škodlivé platformy pomocí hlasových příkazů na zařízeních Amazon Echo.

Mnoho uživatelů často špatně vyslovuje slova, což často vede k chybám při interpretaci Alexou, řečovým strojem napájejícím Amazon Echo. Vědci použili 11 460 vzorků řeči ze slov v angličtině, kterými mluví Američané.

Poté studovali, kde Alexa nesprávně interpretovala hlasové příkazy, jak často to dělá a proč. Byli schopni zjistit, že pravidelně dochází k určitým dezinterpretacím.

Takže pomocí „Skill squatting“ může hacker tyto systematické chyby použít k přesměrování uživatelů Amazon Echo na škodlivé aplikace, webové stránky a riziko jejich soukromých informací. Tuto metodu lze použít k cílení na určité demografické údaje, zejména na ty, kteří neumí anglicky.

Ve variantě útoku, kterou nazýváme squadting dovedností oštěpu, dále demonstrujeme, že tento útok může být zaměřen na konkrétní demografické skupiny. Na závěr pojednáváme o bezpečnostních důsledcích chyb při interpretaci řeči, protiopatřeních a budoucí práci.

Problém nemusí být snadná oprava, protože záleží na principech samotného strojového učení, na kterých je Alexa a další stroje AI postaveny. Amazon tvrdí, že má přijata opatření k řešení tohoto problému, ale výzkum University of Illinois říká něco jiného.

Tvrdí, že to nebude snadná oprava a v budoucnu by to přineslo vážné problémy.

Značky Alexa Amazonka